Gen Alpha giờ cứ mở điện thoại ra là xem video AI trên YouTube, TikTok: Nội dung thật giả lẫn lộn, chuyên gia cảnh báo gì?

Video AI chứa nội dung độc hại nhắm vào trẻ em đang tràn lan trên YouTube và TikTok.

Kể từ khi trí tuệ nhân tạo (AI) bùng nổ toàn cầu, một xu hướng mới trên YouTube và các nền tảng video đã xuất hiện: các video dành cho trẻ em được tạo ra bằng AI với hình ảnh và nội dung rất khó kiểm soát, không thể đảm bảo tính lành mạnh.

Nội dung gây sốc và cách thức hoạt động

Những video này thường sử dụng các nhân vật hoạt hình có sẵn hoặc cũng do AI tạo ra, đặt chúng vào những tình huống kỳ lạ, vô nghĩa, đôi khi là kinh dị hoặc bạo lực một cách khó hiểu. Màu sắc lòe loẹt, âm thanh hỗn loạn, và cốt truyện rời rạc, thiếu logic là những đặc điểm dễ nhận thấy. Mục đích chính của chúng dường như chỉ là thu hút sự chú ý của thuật toán đề xuất video, tận dụng các từ khóa và xu hướng tìm kiếm phổ biến của trẻ em mà không hề quan tâm đến tác động tiêu cực tiềm ẩn lên nhận thức và tâm lý của người xem nhỏ tuổi.

Cùng lúc đó, những người theo trào lưu làm giàu nhanh chóng đang lan truyền các video hướng dẫn, chỉ cách sử dụng các công cụ như ChatGPT, ElevenLabs và Adobe Express để tạo ra nội dung hoạt hình đơn giản, thu hút hàng triệu lượt xem và doanh thu lớn.

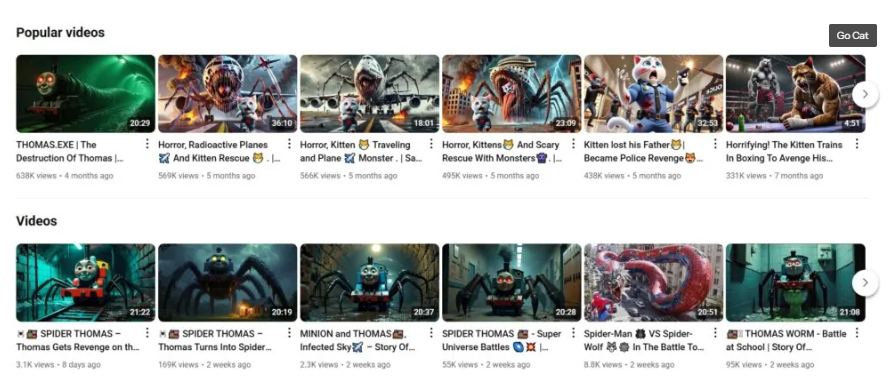

Các video có thể “núp bóng” sử dụng các nhân vật được trẻ em yêu thích như Minion, Elsa hoặc các con vật dễ thương như mèo con. Tuy nhiên, nội dung lại vô cùng đáng lo ngại. Một số video có thể miêu tả một Minion biến thành quái vật trong cống rãnh, hoặc các nhân vật hoạt hình bị bạo hành.

Một kênh có tên "Go Cat" đăng tải các video về những chú mèo con dễ thương nhưng lại bị đánh đập bởi mèo mẹ. Mặc dù kênh này mô tả nội dung của mình là "tràn đầy trí tưởng tượng và hoạt hình đầy màu sắc dành cho trẻ em", các cảnh quay thực tế lại rất bạo lực và đáng buồn.

Các video cho trẻ em có nội dung bạo lực hoặc vô nghĩa

Nhiều video khác sử dụng các từ khóa tìm kiếm đơn giản như "minions" hoặc "cute cats" (mèo dễ thương) để xuất hiện gần các video dành cho trẻ em và video giáo dục. Chúng cũng sử dụng các hashtag như #funnycat (mèo vui vẻ), #familyfun (gia đình vui vẻ) hoặc #animalrescue (giải cứu động vật) để đánh lừa thuật toán của YouTube.

Lo ngại của phụ huynh và các chuyên gia

Các chuyên gia lo ngại rằng làn sóng nội dung này đang làm gia tăng số lượng "video rác" trên mạng, “chiếm lĩnh” một phần không nhỏ không gian giải trí của trẻ nhỏ toàn cầu. Nhiều kênh sử dụng hoạt hình 3D có phong cách tương tự Cocomelon (kênh YouTube dành cho trẻ em nổi tiếng) để thu hút trẻ, khiến phụ huynh dễ nhầm lẫn và không biết con đang xem video nào. Các video này thường được tạo ra một cách vội vã, ồn ào và thiếu sáng tạo, chỉ nhằm mục đích thu hút lượt xem và kiếm tiền.

Hiện tượng này bị các chuyên gia lo ngại sẽ tạo ra cái gọi là "Elsagate" thế hệ thứ hai. Vụ bê bối "Elsagate" lần đầu xuất hiện vào năm 2017, khi hàng ngàn video giả dạng thân thiện với trẻ em nhưng lại chứa nội dung lạm dụng hoặc tình dục. YouTube đã phản ứng bằng cách xóa hàng triệu quảng cáo, hàng ngàn video và chấm dứt hoạt động của nhiều kênh.

Tuy nhiên, với sự phát triển của công nghệ AI, vấn đề này trở nên phức tạp hơn. Các công cụ AI tạo sinh cho phép bất kỳ ai cũng có thể tạo ra các video hoạt hình có tính chân thực cao một cách nhanh chóng, chi phí thấp và không cần kỹ năng nghệ thuật. Điều này giúp các kênh có thể sản xuất hàng loạt video, trong đó có thể gồm video độc hại với số lượng lớn mỗi ngày.

Ảnh minh họa

Một số người đăng tải khẳng định video của họ mang tính giáo dục, nhưng chất lượng thì khác nhau. Cũng rất khó có khả năng bất kỳ video AI sản xuất hàng loạt nào được tung ra thị trường sau khi tham khảo ý kiến của các chuyên gia phát triển trẻ em. Nếu mục tiêu là kiếm tiền thông qua những giấc mơ sốt sắng do AI tạo ra, được thiết kế để trẻ mới biết đi chưa quen với phương tiện truyền thông sử dụng, thì lập luận "chúng tôi đang giúp các em học!" nghe có vẻ khá hời hợt.

Theo Wired, các nhà nghiên cứu như nhà khoa học thần kinh Eric Hoel của Đại học Tufts (Mỹ) lo ngại về việc sự kết hợp ảm đạm giữa nội dung AI lộn xộn và thời lượng sử dụng màn hình kéo dài cuối cùng sẽ ảnh hưởng đến trẻ em ngày nay như thế nào.

"Khắp đất nước, trẻ con ngồi trước iPad và chịu đựng dòng chảy nhân tạo", nhà khoa học này gần đây đã viết trên Substack, The Intrinsic Perspective. "Không còn từ nào khác ngoài từ "dystopia" (phản địa đàng)".

YouTube chia sẻ với Wired rằng "phương pháp chính" của họ để chống lại làn sóng nội dung do AI tạo ra tràn ngập nền tảng của mình "sẽ là yêu cầu chính những người sáng tạo nội dung phải tiết lộ khi họ tạo ra nội dung đã bị thay đổi hoặc tổng hợp nhưng vẫn chân thực". YouTube cũng nhấn mạnh rằng họ đã sử dụng hệ thống "bộ lọc tự động, đánh giá của con người và phản hồi của người dùng" để kiểm duyệt nền tảng YouTube Kids.

Tuy nhiên, rõ ràng là rất nhiều nội dung tự động dành cho trẻ em đang bị bỏ sót khỏi hệ thống tự báo cáo.

"Sự giám sát có ý nghĩa của con người, đặc biệt là đối với AI tạo sinh, là vô cùng quan trọng", Tracy Pizzo Frey, cố vấn AI cấp cao của tổ chức phi lợi nhuận về truyền thông Common Sense Media, nói với Wired. "Trách nhiệm đó không nên hoàn toàn đổ lên vai các gia đình."

Phản ứng của các nền tảng và người dùng

YouTube đang giới thiệu các chính sách mới yêu cầu người sáng tạo phải công khai khi sử dụng AI để tạo nội dung chân thực. Tuy nhiên, các nhà phê bình cho rằng chính sách này còn nhiều lỗ hổng và không đủ để ngăn chặn nội dung xấu. Họ nhấn mạnh rằng việc thiếu sự giám sát của con người trong quá trình sản xuất nội dung AI là một mối đe dọa lớn, vì các kênh có thể đăng tải hàng loạt video mà không được kiểm duyệt trước.

YouTube cho biết họ đã xóa một số kênh bị gắn cờ và vô hiệu hóa chức năng kiếm tiền của những kênh khác. Một người phát ngôn của YouTube khẳng định nền tảng này sử dụng cả nhân viên kiểm duyệt và công nghệ để thực thi chính sách an toàn cho trẻ em.

Thế nhưng các kênh độc hại vẫn tiếp tục xuất hiện bằng cách thay đổi tên hoặc tạo tài khoản mới. Nhiều người dùng và các nhà sáng tạo nội dung đã lên tiếng cảnh báo về vấn đề này. Một YouTuber có tên BitterSnake đã chia sẻ hình ảnh cho thấy một số người đang làm việc trong văn phòng, có khả năng ở nước ngoài, đang tạo ra các video AI bạo lực có hàng triệu view này.

Ảnh minh họa

Các video này không chỉ gây tổn hại đến tâm lý trẻ em mà còn đặt ra câu hỏi về khả năng quản lý nội dung của các nền tảng. Khi công nghệ AI ngày càng phát triển, việc phân biệt giữa video thật và video được tạo ra bởi AI trở nên khó khăn hơn. Điều này đòi hỏi phụ huynh phải tích cực giám sát và đồng hành cùng con cái trong việc sử dụng các nền tảng mạng xã hội. Cha mẹ được khuyến khích nên tham gia nhiều hơn vào việc dành thời gian cho con cái khi chúng sử dụng phương tiện truyền thông, đảm bảo rằng chúng đưa ra những lựa chọn phù hợp. Và khi bạn bắt gặp những video rõ ràng là không phù hợp, hãy tận dụng công cụ báo cáo của nền tảng để đảm bảo rằng có người có thẩm quyền xem xét chúng.

Giới chuyên gia cũng cho rằng trách nhiệm không chỉ thuộc về phụ huynh mà còn phải có sự giám sát có ý nghĩa từ các nhà sáng tạo và các nền tảng như YouTube, TikTok để đảm bảo rằng nội dung dành cho trẻ em là an toàn và có giá trị.

Nguồn: Wired, Futurism