Xoay quanh clip nóng giả mạo Ninh Dương Lan Ngọc, nhiều người "gọi hồn" Deepfake, vậy nó là gì?

Dựa trên công nghệ Trí Tuệ Nhân Tạo (AI), đây không phải là lần đầu tiên người ta gọi tên Deepfake khi có hình ảnh một ai đó bị “bôi nhọ” trên mạng xã hội.

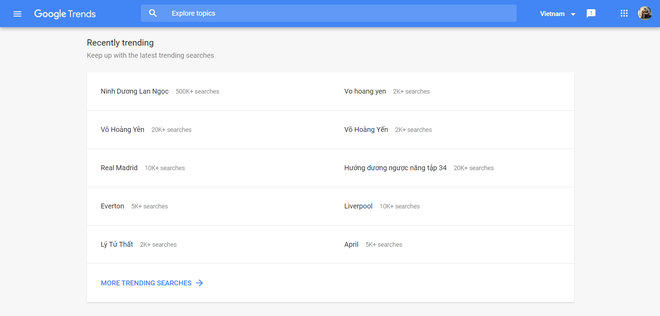

Có thể nói, từ khoá hot nhất trong ngày hôm nay (2/3) chính là "Ninh Dương Lan Ngọc", sau khi nữ diễn viên được cho là đã bị lộ clip nóng và nó thì như thường lệ, lan tràn trên khắp các mạng xã hội với tốc độ chóng mặt.

Leo thẳng lên top 1 trending với hơn nửa triệu lượt tìm kiếm

Rất nhanh chóng, nữ diễn viên và cả quản lý đã lên tiếng bác bỏ tính xác thực của những hình ảnh nói trên và cho rằng, đây là những hình ảnh đã bị can thiệp chỉnh sửa. Hiện tại, đại diện của Lan Ngọc cho biết vẫn chưa tìm được thủ phạm của những hành động sai trái này, tuy nhiên, công cụ để chúng dùng để thực hiện các hành vi nói trên đã được vị quản lý chỉ đích danh. Không quá bất ngờ, đó chính là Deepfake.

Hình ảnh cắt ra từ clip

Trong một bài phân tích khá kỹ lưỡng về Deepfake trước đây (bạn có thể tìm đọc lại tại đây), chúng mình đã làm rõ nguyên lý hoạt động của công nghệ này. Có thể hiểu đơn giản, Deepfake sử dụng trí tuệ nhân tạo để ghép mặt của một người này, sang cho một người hoàn toàn khác mà không cần phải có bất kỳ điểm tương đồng nào về mặt nhận diện. Ở trường hợp của diễn viên Ninh Dương Lan Ngọc, theo kết luận của cô lẫn người quản lý, thì rất có thể gương mặt của diễn viên này đã bị sử dụng và ghép vào mặt của một nữ diễn viên phim khiêu dâm nào đó, nhằm mục đích xấu.

Deepfake hiểu đơn giản là AI dùng khuôn mặt của người này, ghép sang mặt của một người hoàn toàn khác

Trên thực tế, đã có rất nhiều ngôi sao trên thế giới vướng vào các lùm xùm vì các loại video khiêu dâm dạng này và không ít trong số đó có thủ phạm đứng đằng sau là công nghệ Deepfake. Điển hình là Lisa - thành viên của nhóm nhạc Hàn Quốc đình đám Blackpink hay ngôi sao của bộ phim đình đám Hậu Duệ Mặt Trời - nữ diễn viên Song Hye-kyo và còn rất nhiều cái tên khác.

Có thể nói, để có thể ghép khớp từng frame như những video đang lan tràn trên khắp các mạng xã hội, những đối tượng kể trên có thể mất rất nhiều thời gian và những chiếc máy tính đủ mạnh mẽ để có thể xuất ra những sản phẩm đủ "chất lượng" để thuyết phục người xem. Tuy nhiên, ở một góc độ khác, với những nhu cầu vui vẻ, một người dùng thông thường hoàn toàn có thể sử dụng một ứng dụng di động để ghép mặt bản thân vào một đoạn video ngắn của một nhân vật mà mình yêu thích.

Video này ghép một tấm ảnh selfie với một vài đoạn footage của Iron Man, trông khá thuyết phục

Vậy câu hỏi đặt ra là, còn bao lâu cho đến khi những công nghệ nguy hiểm như Deepfake có thể phát triển đủ tối ưu để phổ cập đến đại chúng. Sẽ có bao nhiêu cá nhân sẽ bị công kích vì những hình ảnh thậm chí họ không hề biết rằng nó có tồn tại?

Deepfake nói riêng hay công nghệ AI nói chung có thể nói là một bước tiến, một thành tựu to lớn của khoa học công nghệ hiện đại, nhưng đây cũng là minh chứng cho việc, nếu không được quản lý và sử dụng một cách thông minh, bất kỳ điều gì trên thế giới, dẫu được tạo ra với mục đích tốt, đều có thể bị lợi dụng cho các mục đích xấu xa.

Nguồn: Tổng hợp